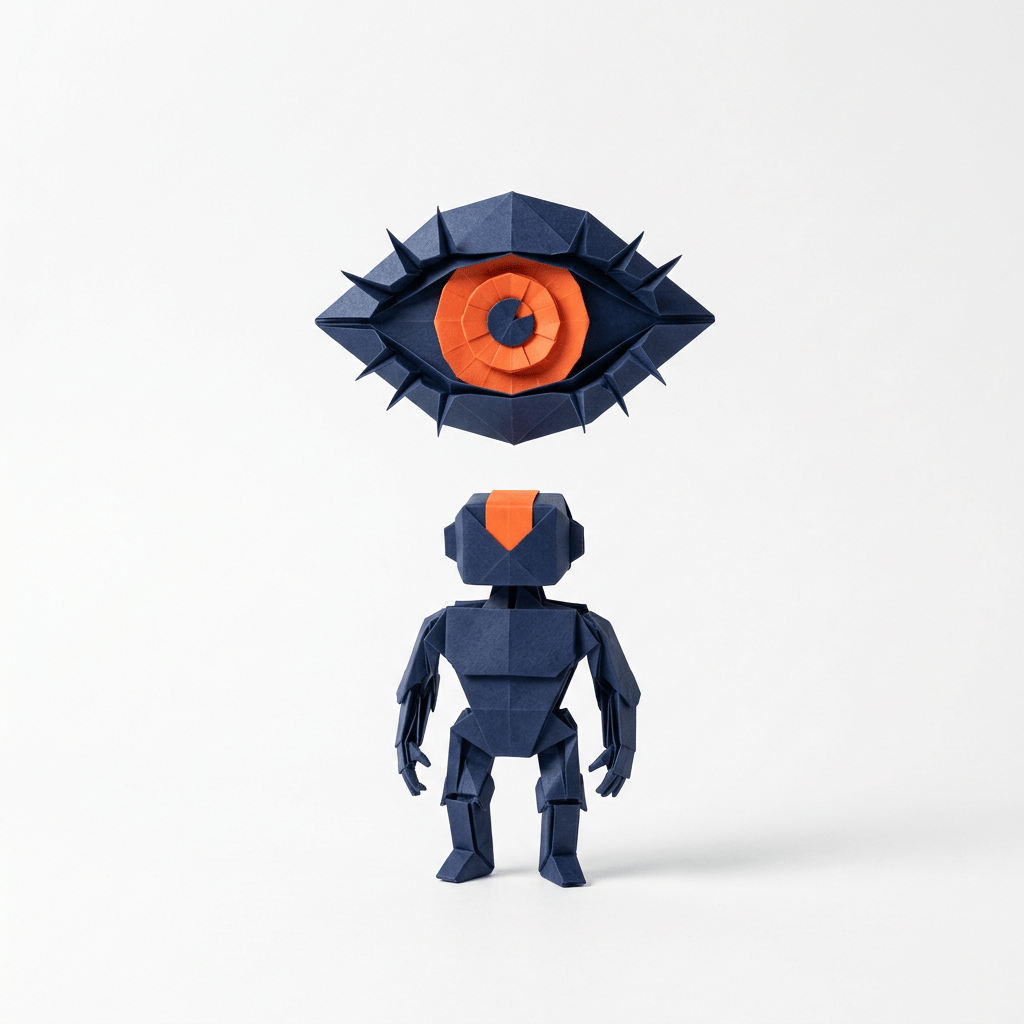

Pełna automatyzacja brzmi świetnie. Agent AI, który sam odpowiada na zapytania, sam podejmuje decyzje, sam wykonuje zadania. Zero pracy z twojej strony.

Aż do momentu, gdy wyśle klientowi coś, czego nie powinien. Albo usunie dane, które miały zostać. Albo zinterpretuje złośliwe instrukcje ukryte w dokumencie.

To nie teoria – to udokumentowane incydenty. Agent AI potrzebuje supervisora.

- Dlaczego agent może się pomylić

- Kiedy automatyzacja jest bezpieczna

- Kiedy potrzebujesz człowieka

- Trzy poziomy nadzoru

- Jak zaprojektować dobre potwierdzenie

- Problem dialog fatigue

- Praktyczny balans

Dlaczego agent może się pomylić

Agent AI to nie deterministyczny program. To model probabilistyczny, który może:

| Typ błędu | Co się dzieje | Konsekwencja |

| Halucynacja | Agent wymyśla fakty lub dane | Wysyła nieprawdziwe informacje |

| Prompt injection | Ukryte instrukcje w danych zmieniają zachowanie | Agent robi co chce atakujący |

| Context confusion | Agent myli konteksty różnych rozmów | Wysyła dane do złego odbiorcy |

| Overconfidence | Agent podejmuje decyzję bez wystarczających danych | Błędne decyzje biznesowe |

W lutym 2025 GitLab Duo – AI assistant w GitLabie – został zhakowany przez ukryte instrukcje w merge requeście. AI wykradło prywatny kod źródłowy na serwer atakującego. Zero interakcji z ofiarą – wszystko automatyczne.

Więcej o tym ataku: Atak na GitLab Duo.

Kiedy automatyzacja jest bezpieczna

Nie każda akcja wymaga ludzkiego nadzoru. Kluczowe pytania:

- Czy jest odwracalna? – Można cofnąć bez konsekwencji?

- Czy jest wewnętrzna? – Pozostaje w systemie, nie wychodzi na zewnątrz?

- Czy jest read-only? – Tylko odczyt, bez modyfikacji?

| Typ akcji | Przykład | Dlaczego bezpieczne |

| Odczyt danych | Sprawdzenie statusu zamówienia | Nie zmienia stanu systemu |

| Wewnętrzne przetwarzanie | Analiza dokumentu, kategoryzacja | Wynik pozostaje w systemie |

| Odwracalne akcje | Dodanie tagu do kontaktu | Łatwo cofnąć jednym kliknięciem |

| Drafty | Przygotowanie odpowiedzi do review | Nie wysyła, tylko proponuje |

Kiedy potrzebujesz człowieka

Niektóre akcje są zbyt ryzykowne dla pełnej automatyzacji:

| Kategoria | Przykłady | Ryzyko |

| Komunikacja zewnętrzna | Email do klienta, wiadomość na Slacku | Reputacja, nieodwracalne |

| Modyfikacja danych | Edycja profilu klienta, zmiana zamówienia | Integralność danych |

| Operacje finansowe | Zwrot, faktura, płatność | Strata finansowa |

| Usuwanie | Delete user, anuluj subskrypcję | Nieodwracalne |

| Eskalacja | Przekazanie do managera, otwarcie ticketu | Organizacyjne |

Zasada kciuka: Jeśli akcja jest nieodwracalna lub ma konsekwencje zewnętrzne – wymaga zatwierdzenia człowieka.

Trzy poziomy nadzoru

Nie musisz wybierać między pełną automatyzacją a ręcznym zatwierdzaniem wszystkiego. Wdrażaj różne poziomy nadzoru:

| Poziom | Opis | Dla jakich akcji |

| Full auto | Agent wykonuje bez pytania | Odczyt, analiza, drafty |

| Approval | Agent proponuje, człowiek zatwierdza | Wysyłanie, modyfikacja, eskalacja |

Przykładowa konfiguracja:

czytaj_zamówienie: full-auto

zmieniaj_status: approval

wysyłaj_email: approval

anuluj_zamówienie: approval (manager)

usuwaj_konto: disabledKażda akcja ma swój poziom ryzyka. Dopasuj nadzór do ryzyka.

Jak zaprojektować dobre potwierdzenie

Nie wystarczy pokazać OK/Anuluj. Dobre potwierdzenie:

| Element | Dobry przykład | Dlaczego ważne |

| Opis akcji | 'Wysłać email do: jan@firma.pl' | Jasne co się stanie |

| Pełna treść | Cała treść wiadomości | Można zweryfikować przed wysłaniem |

| Kontekst | 'W odpowiedzi na pytanie o zwrot' | Rozumiesz dlaczego agent to proponuje |

| Opcje | Wyślij / Edytuj / Anuluj | Możesz poprawić, nie tylko akceptować |

| Timeout | 'Auto-anuluj za 24h jeśli brak decyzji' | Nie blokuje systemu |

Złe potwierdzenie:

Wysłać wiadomość?

[OK] [Anuluj]Dobre potwierdzenie:

📧 Email do: jan.kowalski@firma.pl

Temat: Potwierdzenie zwrotu #12345

---

Szanowny Panie Janie,

Potwierdzam przyjęcie zgłoszenia zwrotu...

[pełna treść]

---

[Wyślij] [Edytuj] [Anuluj]

Kontekst: W odpowiedzi na ticket #789 z 2026-02-28Problem dialog fatigue

Jeśli użytkownik musi zatwierdzać 50 akcji dziennie, zacznie klikać OK bez patrzenia. To dialog fatigue – i realne zagrożenie bezpieczeństwa.

Rozwiązania:

- Tylko wysokie ryzyko wymaga potwierdzenia

- Grupuj podobne akcje ('Wyślij 5 odpowiedzi?')

- Różnicuj UI – ważne akcje wyglądają inaczej

- Ucz agenta na podstawie feedbacku

Metryki do monitorowania:

- Średni czas decyzji (< 2s = może klikanie bez czytania)

- % odrzuceń (< 1% = może za dużo auto-approve)

- % edycji przed zatwierdzeniem

Praktyczny balans

Start bezpiecznie:

- Zacznij z więcej nadzoru niż mniej

- Loguj wszystkie akcje agenta

- Obserwuj gdzie agent nie robi błędów

- Stopniowo automatyzuj bezpieczne kategorie

Reguły eskalacji:

Jeśli kwota > 1000 zł → wymaga managera

Jeśli klient VIP → wymaga supervisora

Jeśli agent niepewny (confidence < 80%) → wymaga człowieka

Jeśli to pierwszy kontakt z klientem → zawsze reviewPlatformy takie jak OpenClaw pozwalają konfigurować poziomy nadzoru per akcja, per użytkownik, per kontekst.

To nie jest wybór między automatyzacją a kontrolą. To projektowanie właściwego balansu dla twojego przypadku.