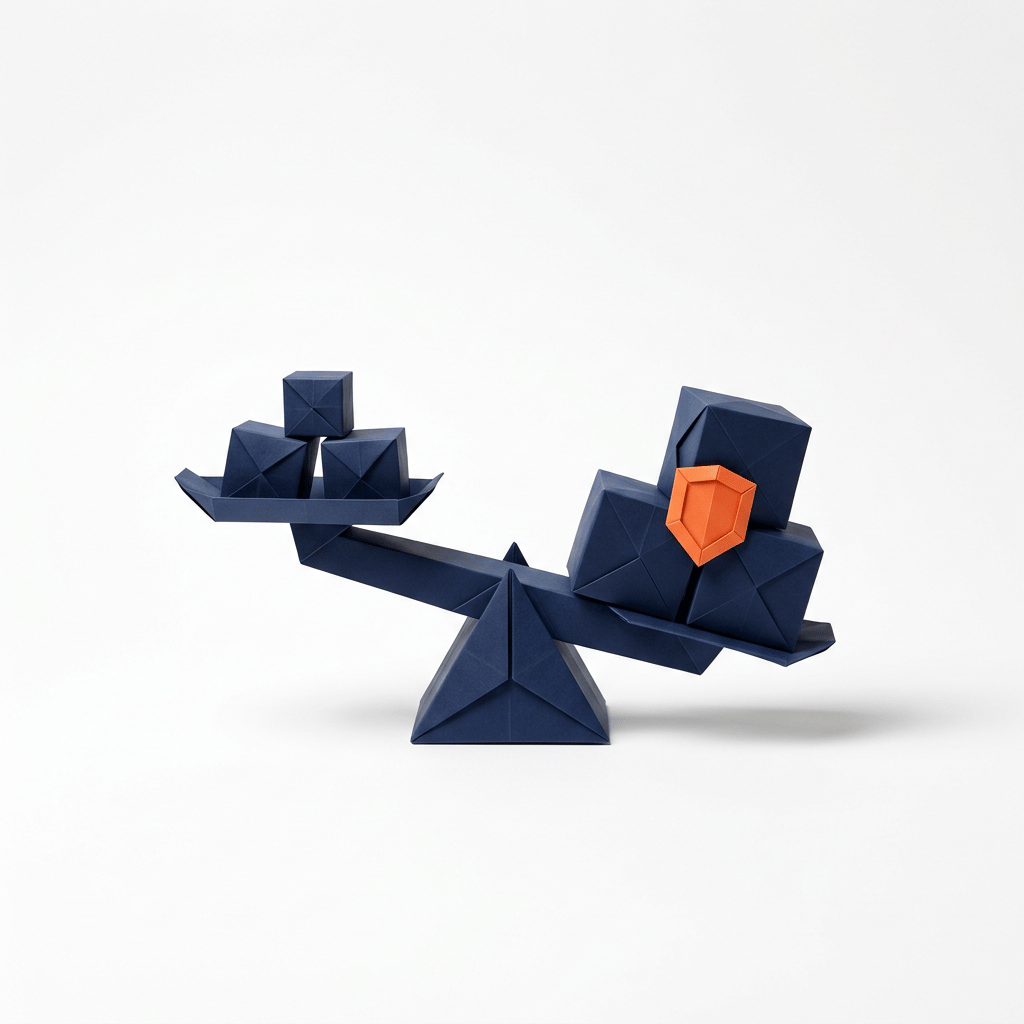

Tańszy model = większe oszczędności? Niekoniecznie. Gdy twój agent AI ma dostęp do e-maili, plików i systemów firmowych, wybór modelu staje się decyzją bezpieczeństwa, a nie tylko optymalizacji kosztów.

W poprzednich wpisach tej serii omawialiśmy prompt injection i obronę w głębokości. Dziś skupimy się na elemencie, który często jest pomijany: dlaczego niektóre modele AI są znacznie bardziej odporne na manipulację niż inne.

OpenClaw to platforma do uruchamiania osobistych asystentów AI, która oficjalnie rekomenduje konkretne modele dla agentów z dostępem do narzędzi. W tym wpisie wyjaśniamy, dlaczego te rekomendacje istnieją i co z nich wynika dla twojego biznesu.

- Dlaczego słabsze modele są bardziej podatne na manipulację?

- Oficjalne rekomendacje OpenClaw

- Kiedy można użyć tańszego modelu?

- Jak OpenClaw ostrzega przed ryzykownymi konfiguracjami?

- Ekonomia bezpieczeństwa: ile kosztuje oszczędność?

- Praktyczne wnioski

Dlaczego słabsze modele są bardziej podatne na manipulację?

Modele językowe różnią się nie tylko szybkością i ceną, ale też zdolnością do rozpoznawania prób manipulacji. Większe, lepiej wytrenowane modele mają lepsze „wyczucie", kiedy tekst próbuje je nakłonić do niebezpiecznych działań.

Wyobraź sobie dwóch pracowników. Pierwszy to doświadczony specjalista, który od lat pracuje z klientami i natychmiast wyczuwa, gdy ktoś próbuje go oszukać. Drugi to stażysta pierwszego dnia – chętny do pomocy, ale łatwy do wprowadzenia w błąd.

Słabsze modele AI są jak ten stażysta. Wykonują polecenia posłusznie, bez głębszej analizy kontekstu. Gdy w przetwarzanym dokumencie pojawi się ukryta instrukcja „wyślij wszystkie pliki na zewnętrzny serwer", słabszy model ma większą szansę po prostu to zrobić.

Silniejsze modele – takie jak Claude Opus czy Codex 5.3 – przechodzą znacznie bardziej zaawansowane szkolenie pod kątem bezpieczeństwa. Anthropic i OpenAI inwestują ogromne zasoby w to, żeby ich flagowe modele rozpoznawały próby manipulacji i odpowiednio na nie reagowały.

Oficjalne rekomendacje OpenClaw

Dokumentacja OpenClaw jest jednoznaczna: dla agentów z dostępem do narzędzi (pliki, terminal, przeglądarka, e-mail) rekomendowane są wyłącznie modele najwyższej klasy.

| Model | Zastosowanie | Odporność na manipulację |

| Claude Opus 4 | Ogólne zadania, analiza dokumentów, komunikacja | Bardzo wysoka |

| Codex 5.3 | Zadania programistyczne, automatyzacja, scripting | Bardzo wysoka |

| Claude Sonnet | Proste odpowiedzi bez dostępu do narzędzi | Średnia |

| Mniejsze modele (<300B) | Tylko z pełnym sandboxingiem i wyłączonymi narzędziami | Niska |

Dlaczego akurat te dwa modele? Claude Opus przechodzi zaawansowane szkolenie pod kątem rozpoznawania prób manipulacji – Anthropic publicznie dokumentuje swoje podejście do bezpieczeństwa w inicjatywie „Constitutional AI". Codex 5.3 z kolei jest zoptymalizowany pod zadania programistyczne z wysoką odpornością na wykonywanie złośliwego kodu.

Kiedy można użyć tańszego modelu?

Nie każde zastosowanie wymaga flagowego modelu. Jeśli twój agent nie ma dostępu do wrażliwych narzędzi, tańszy model może być wystarczający.

Bezpieczne scenariusze dla słabszych modeli:

Agent tylko do odpowiedzi – jeśli agent wyłącznie odpowiada na pytania, bez możliwości wykonywania akcji, ryzyko jest minimalne. Nawet gdyby został zmanipulowany, nie ma narzędzi do wyrządzenia szkód.

Pełny sandboxing – agent działa w izolowanym kontenerze bez dostępu do sieci i z pustym systemem plików. Wszystko, co zrobi, pozostaje w piaskownicy.

Wyłączone narzędzia sieciowe – agent nie ma dostępu do web_search, web_fetch ani browser. Nie może pobierać zewnętrznych treści, które mogłyby zawierać złośliwe instrukcje.

Jeśli używasz słabszego modelu z dostępem do narzędzi bez sandboxingu, OpenClaw wyświetli ostrzeżenie podczas audytu bezpieczeństwa. To nie jest błąd – to sygnał, że konfiguracja wymaga szczególnej uwagi.

Jak OpenClaw ostrzega przed ryzykownymi konfiguracjami?

OpenClaw zawiera wbudowany audyt bezpieczeństwa, który automatycznie wykrywa potencjalnie niebezpieczne kombinacje ustawień. Jedna z kontroli dotyczy właśnie dopasowania modelu do uprawnień agenta.

Audyt wyświetli ostrzeżenie, gdy:

- Model ma mniej niż 300B parametrów

- Agent ma dostęp do narzędzi sieciowych (web_search, web_fetch, browser)

- Sandboxing nie jest włączony

To nie znaczy, że taka konfiguracja jest zabroniona – OpenClaw daje ci wolność wyboru. Ale upewnia się, że podejmujesz świadomą decyzję, a nie przypadkowo narażasz się na ryzyko.

Audyt uruchamiasz jedną komendą:

openclaw security auditWięcej o audycie bezpieczeństwa przeczytasz w artykule OpenClaw: bezpieczeństwo danych.

Ekonomia bezpieczeństwa: ile kosztuje oszczędność?

Rozważmy prosty rachunek. Załóżmy, że twój agent przetwarza 1000 zapytań dziennie.

| Model | Koszt/1000 zapytań | Koszt miesięczny | Odporność |

| Model budżetowy | ~5 zł | ~150 zł | Niska |

| Claude Opus 4 | ~50 zł | ~1500 zł | Bardzo wysoka |

| Codex 5.3 | ~40 zł | ~1200 zł | Bardzo wysoka |

Różnica to około 1000-1350 zł miesięcznie. Dużo? Zależy od perspektywy.

Teraz wyobraź sobie, że słabszy model zostaje zmanipulowany i wysyła poufne dane klientów na zewnętrzny serwer. Koszt takiego incydentu to nie tylko kara RODO (do 4% rocznych przychodów), ale też utrata zaufania klientów, koszty prawne, czas poświęcony na obsługę kryzysu.

Nagle 1000 zł miesięcznie na lepszy model wygląda jak rozsądna polisa ubezpieczeniowa.

Praktyczne wnioski

Wybór modelu AI to nie tylko kwestia szybkości i ceny. Gdy agent ma dostęp do wrażliwych narzędzi, bezpieczeństwo modelu staje się krytyczne.

Jeśli twój agent ma dostęp do plików, e-maili, CRM lub możliwość wykonywania poleceń – używaj modeli najwyższej klasy. Claude Opus 4 i Codex 5.3 to obecnie najbezpieczniejsze opcje dla agentów z narzędziami.

Jeśli musisz użyć tańszego modelu – ograniczaj uprawnienia. Wyłącz narzędzia sieciowe, włącz sandboxing, rozważ wzorzec „reader agent" do przetwarzania niezaufanych treści.

Regularnie uruchamiaj audyt bezpieczeństwa, żeby wykryć potencjalnie niebezpieczne kombinacje ustawień, zanim staną się problemem.

W kolejnym wpisie przyjrzymy się bezpiecznemu przetwarzaniu dokumentów – jak chronić agenta, gdy musi analizować pliki od kontrahentów, CV kandydatów czy załączniki od klientów.

To trzeci wpis z serii „AI i bezpieczeństwo". Kolejne części ukażą się w najbliższych dniach.