OPUBLIKOWANO: 11 lutego 2026

Wdrożenie AI dla jednej osoby bywa proste: konfigurujesz asystenta pod siebie, ustawiasz preferencje i gotowe. Wdrożenie AI dla zespołu to zupełnie inna gra. Pojawiają się role, uprawnienia, silosy wiedzy, różne kanały komunikacji i pytanie, które potrafi zabić większość projektów: kto ma dostęp do jakich danych i kto odpowiada za wynik?

Właśnie w tym miejscu wiele „typowych” narzędzi AI zaczyna się sypać. Licencje per użytkownik rozwiązują głównie problem zakupowy. Nie rozwiązują problemu operacyjnego: kontroli dostępu, integracji w procesach i utrzymania spójnego standardu pracy.

OpenClaw rozwiązuje ten problem architekturą. Możesz mieć jeden Gateway jako centralny węzeł, wielu użytkowników działających w swoich kanałach (Slack/Discord/WhatsApp/Telegram), kilku wyspecjalizowanych agentów (HR/Sales/Dev) i precyzyjne zasady: co jest dozwolone, co jest tylko do odczytu, a co wymaga zatwierdzenia. W tym artykule pokażę Ci, jak zaprojektować wdrożenie OpenClaw w firmie z wieloma użytkownikami – bez chaosu i bez niepotrzebnego ryzyka.

- Dlaczego AI „dla zespołu” to inny problem niż AI „dla siebie”

- Architektura: jeden Gateway, wielu użytkowników, wielu agentów

- Uprawnienia i bezpieczeństwo: least privilege + human‑in‑the‑loop

- Zarządzanie wiedzą: wspólne zasady, różne konteksty

- Plan wdrożenia: 7 dni do MVP (i co mierzyć)

- Najczęstsze pułapki (i jak ich uniknąć)

- Podsumowanie

Dlaczego AI „dla zespołu” to inny problem niż AI „dla siebie”

W zespole AI nie jest tylko narzędziem – staje się elementem systemu pracy. To oznacza, że musisz rozwiązać trzy problemy naraz.

Pierwszy problem to silosy. Jeśli każdy ma własne konto w czacie AI, wiedza i dobre praktyki nie skalują się. Handlowiec może mieć świetne odpowiedzi na obiekcje, ale nowa osoba zaczyna od zera. Zespół traci czas na powtarzanie tego samego.

Drugi problem to uprawnienia. Asystent z dostępem do integracji może wykonywać akcje: wysłać maila, zmienić status w CRM, wygenerować raport. W zespole musisz mieć jasność, kto może co uruchamiać – inaczej AI staje się ryzykiem, a nie przewagą.

Trzeci problem to kanały. Zespół nie przerzuci się „magicznie” na jedną platformę. Sales ma swoje komunikatory, dev swoje, zarząd swoje. Wdrożenie AI, które wymaga zmiany narzędzi, zwykle przegrywa z przyzwyczajeniami.

Architektura: jeden Gateway, wielu użytkowników, wielu agentów

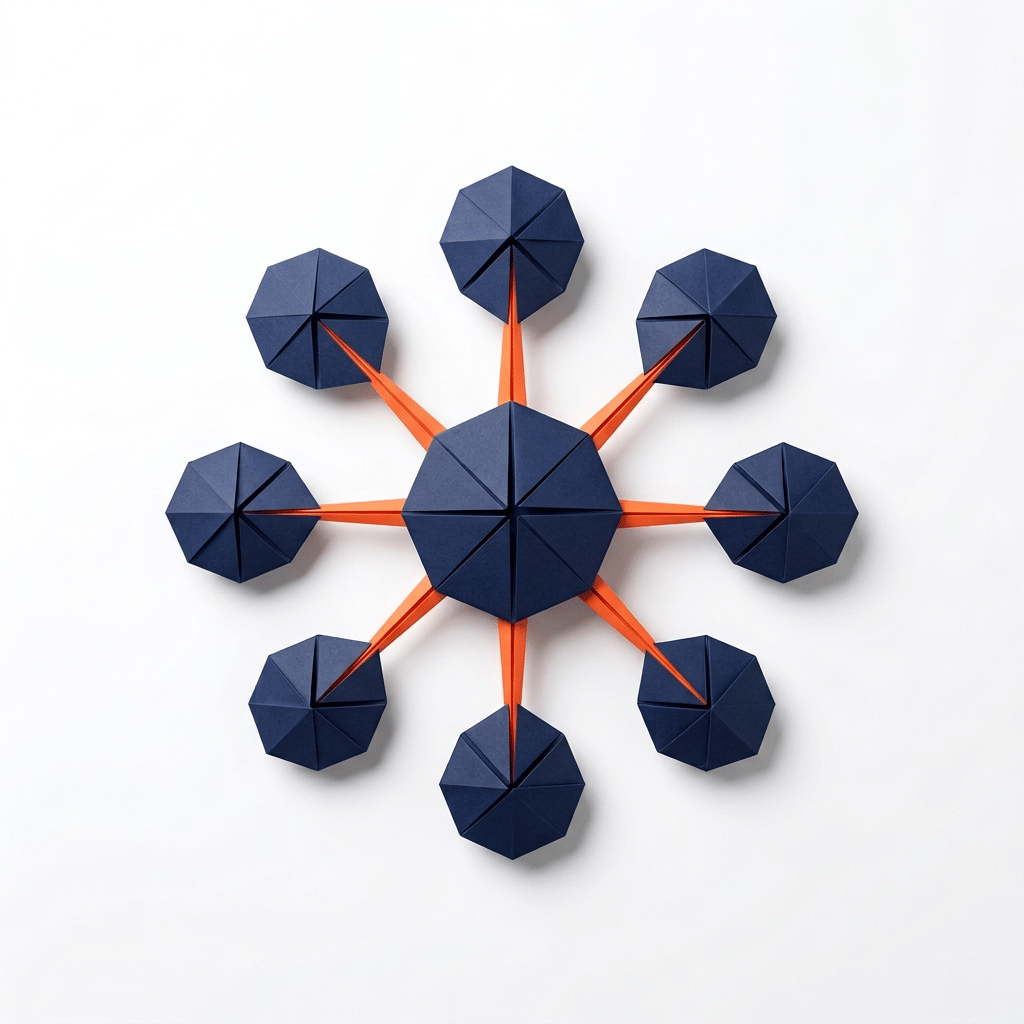

Gateway jest centralnym węzłem: odbiera wiadomości z kanałów, egzekwuje polityki, kieruje rozmowę do odpowiednich agentów i uruchamia narzędzia. To podejście ma dwie zalety: jedną konfigurację i jedno miejsce kontroli. Z perspektywy zespołu oznacza to, że nie wdrażasz „50 asystentów”, tylko jeden system obsługujący wiele osób.

Kluczowym wzorcem dla firm jest model multi-agent. Zamiast jednego „uniwersalnego bota” masz kilku specjalistów. Agent HR odpowiada na pytania o polityki i onboarding, agent Sales pomaga w ofertach i follow-upach, a agent Dev ma dostęp do repozytorium i CI. Każdy agent ma własny workspace, własne umiejętności i jasno zdefiniowane granice.

Routing możesz zrobić prosto: kanał #hr-pytania kierujesz do HR-agenta, kanał #sales-oferty do Sales-agenta, a #dev-help do Dev-agenta. To podejście jest intuicyjne i nie wymaga od ludzi uczenia się „jak rozmawiać z routerem”.

| Agent | Co robi | Typowe integracje | Bezpieczny start |

| HR | Polityki, onboarding, FAQ | Dokumenty, wiki | Read‑only + odpowiedzi z bazy wiedzy |

| Sales | Oferty, follow‑upy, analiza leadów | CRM, dokumenty ofertowe | Drafty i rekomendacje do zatwierdzenia |

| Dev | Dokumentacja, PR, CI, debug | GitHub, CI/CD | Raporty statusu + sugestie, bez deploy na start |

Uprawnienia i bezpieczeństwo: least privilege + human‑in‑the‑loop

W zespole nie wystarczy „AI, które działa”. Potrzebujesz AI, które działa w granicach. Najlepsza praktyka to allowlisty (pozwalamy na A/B/C zamiast „zabraniamy X/Y/Z”) oraz zasada najmniejszych uprawnień.

Przykład: stażysta może pytać o dokumentację i procedury, ale nie uruchamia narzędzi wykonawczych ani nie widzi danych finansowych. Menedżer może generować raporty i przygotowywać szkice komunikatów, ale nie ma dostępu do repozytoriów. CTO ma uprawnienia szersze, ale operacje o wysokiej stawce nadal wymagają zatwierdzenia.

Najbezpieczniejszy start to human-in-the-loop: AI przygotowuje odpowiedź lub akcję, a człowiek zatwierdza. To daje wysoką wartość i jednocześnie buduje zaufanie w organizacji. Dopiero gdy proces jest stabilny, zwiększasz autonomię.

Zarządzanie wiedzą: wspólne zasady, różne konteksty

AI w zespole jest tak dobre, jak wiedza, którą ma. Dlatego potrzebujesz single source of truth: dokumentów, procedur, szablonów ofert i runbooków. Jednocześnie nie wszystko powinno być globalne. W codziennej pracy sprawdza się model: globalne zasady firmy + lokalna wiedza działowa.

To rozwiązuje dwa problemy: spójność (wszyscy dostają te same definicje i standardy) oraz bezpieczeństwo (działy widzą tylko to, co powinny). Najgorszy scenariusz to wspólna baza bez granic – wtedy AI zaczyna mieszać konteksty.

Jeśli chcesz szybko podnieść jakość odpowiedzi, zacznij od 10–20 stron „najczęstszych pytań i standardów”. To nie musi być idealne. Ma być aktualne i używane. W OpenClaw wiedza działa najlepiej, gdy jest wersjonowana i ma właściciela.

Plan wdrożenia: 7 dni do MVP (i co mierzyć)

Wdrożenie zespołowe powinno być iteracyjne. Najpierw jeden proces i jeden kanał, potem drugi, potem kolejny. Jeśli spróbujesz „wdrożyć wszystko” od razu, utkniesz w konfiguracji i dyskusjach.

Przykładowy plan na 7 dni:

- Dni 1–2: ustaw Gateway, kanały i polityki dostępu.

- Dni 3–4: uruchom 2–3 agentów (np. HR, Sales, Dev) z minimalnymi uprawnieniami.

- Dni 5–6: wprowadź bazę wiedzy (global + działowa).

- Dzień 7: szkolenie i soft‑launch (jasne zasady użycia).

Od pierwszego dnia mierz trzy rzeczy: adopcję w procesie (kto używa), rework/override (ile trzeba poprawiać) oraz efekt biznesowy (czas oszczędzony albo krótszy czas cyklu procesu). Bez metryk łatwo ulec „wow efektowi”.

Najczęstsze pułapki (i jak ich uniknąć)

Pierwsza pułapka to brak właściciela procesu. Jeśli nikt nie odpowiada za to, jak AI jest używane w dziale, wdrożenie rozmyje się w eksperymentach.

Druga pułapka to zbyt szerokie uprawnienia. W zespole szybciej zbudujesz zaufanie, jeśli na start AI ma ograniczenia i działa w trybie zatwierdzania. „Szybko i ryzykownie” zwykle kończy się wycofaniem narzędzia.

Trzecia pułapka to brak standardu wiedzy. Jeśli baza jest nieaktualna albo sprzeczna, AI zacznie podawać sprzeczne odpowiedzi. To zabija adopcję.

Czwarta pułapka to brak komunikacji: ludzie muszą wiedzieć, do czego jest asystent i do czego nie jest. Jeśli AI ma pomagać, a nie zastępować, trzeba to powiedzieć wprost.

Podsumowanie

AI dla zespołu to projekt operacyjny. Wygrywa nie ten, kto ma „najlepszy model”, tylko ten, kto ma spójne procesy, dobrą bazę wiedzy, jasne uprawnienia i rytm iteracji. OpenClaw daje narzędzia, żeby to zbudować: jeden Gateway, wielu użytkowników, wielu agentów i kontrolę granic.

Jeśli chcesz zacząć mądrze, wybierz jeden dział i jeden proces, ustaw human-in-the-loop, zmierz baseline i dowieź wynik. Potem skaluj. W codziennej pracy to droga, która daje przewagę szybciej niż kolejne licencje per seat.